| 会社名 | ウェルヴィル株式会社 |

|---|---|

| 事業内容 | AI対話エンジン「LIFE TALK ENGINE」の開発および提供 |

| 企業URL | https://wellvill.com/ |

ウェルヴィル株式会社 CTO 樽井俊行 氏 (写真中央)

前職では、基幹業務の巨大なシステムの構築を行う、オブジェクト指向のモデリングの専門家。2010年ごろから言語解釈の研究を開始。2019年暮れよりAI対話エンジンに携わり、現在は自律会話の早期実現を目指す。

- FLEX / HPCサービス"SX-Aurora TSUBASA"

- GPUよりも格段に速度が速く、応答速度が8%改善

- クラウド利用が可能

- 本番環境に適した安定的なサービス提供が可能

- サーバー管理者とコミュニケーションを取ることができ、細やかで小回りの利く対応

AI対話サービスを多方面に展開するAIベンチャーのウェルヴィル株式会社。コア事業の基盤である、AI対話エンジン「LIFE TALK ENGINE」を搭載している KAGOYA のHPCサービス「スーパーコンピューターSX-Aurora TSUBASAクラウド」について話を伺った。

会社のご紹介

対話能力開発に特化したAIベンチャー企業

当社は、2018年に創業したAIベンチャーで、AI分野における対話能力開発に特化した研究開発を行っております。具体的には、アバターとAI対話機能、IoTデバイスとAIセンシング機能など、AIとシナリオを組み立て業務プロセスへの適用をソリューションとして提供しています。

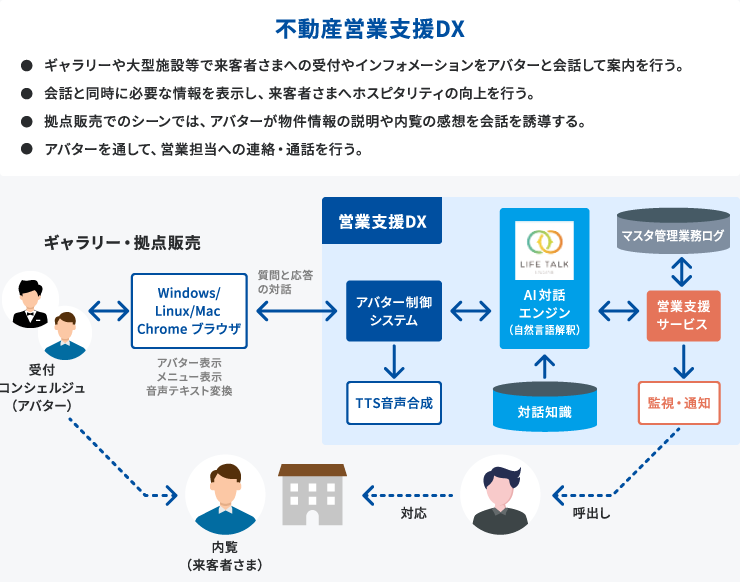

現在のコア事業としては、AI対話エンジン「LIFE TALK ENGINE」(以下、LIFE TALK ENGINE。詳細は後述。)のサービス提供で、特に介護・医療といったヘルスケア分野に力を入れています。その他にも不動産で、営業の代わりのアバターやスマートシティのコンシェルジュの案内、コールセンターのオペレーターなど、幅広い業種へ同サービスを展開しております。

サービス導入のきっかけ

お試し利用でGPUから驚異のスピード改善

クラウド環境での提供元として紹介いただきました

現在、カゴヤさんのHPCサービス「SX-Aurora TSUBASA クラウド」に、我々のコア事業のサービスの中心である「LIFE TALK ENGINE」を搭載しています。

導入の背景としてはNECさんとの繋がりが関係しています。

以前、AIの強化学習の分野で、コンテナへの荷物積込の最適化に深層強化学習のプログラムを実装していました。当時は法人向けのGPUで計算を実行していましたが、ハードウェアをNECさんの「SX-Aurora TSUBASA」に変更してスピード比較を行ったところ、驚異的に早く処理が完了したという経験がありました。

« 参考記事「AI処理で「100万円スパコン」使ってみた GPUからの移行は手間? 対話AIベンチャーが手応え明かす」

また、別の機会に、当時研究を進めていた言語分野の意味解析の定義などで、RNNやTransformerを利用していたものをベクトルコンピューター上で動かすと影響があるかもしれないということで、NECさんと再び実験的にサーバー移行を行った結果、応答速度が8%程度上がるということがありました。

それまで言語処理もGPU上で行っていましたが、ベクトルコンビューターの方が軽く処理が済むということで、以降、暫くは言語分野でも実験的に使用させていただきました。

その後、いよいよ「LIFE TALK ENGINE」をサービスに載せてリリースできる段階になり、本番環境として「SX-Aurora TSUBASA」のクラウド提供がないか相談したところ、カゴヤさんをご紹介いただいたのが導入の経緯です。

KAGOYA を選んだ理由

お客様に提供できる安定したサーバー環境で

きめ細かく小回りの利くクラウド事業者であった

「SX-Aurora TSUBASA」のクラウド提供環境であるというのは必須でしたが、その他のポイントとしては、お客様に提供するサービスなので安定的な環境であることは必須条件で考えておりました。

具体的には、しっかりとした環境であること、小回りが利いて会話ができることが重視点です。カゴヤ様には、非常にきめ細かくサービスでの相談に乗っていただきました。

オンプレミス環境ではなくクラウド環境にした理由ですが、開発環境であれば、自分たちの研究室において行うことはあります。しかし、本番環境としてサービス提供する段階になると、安定的な環境構築という点でクラウドを選択するのは今の時代当然の選択肢だと思っています。私自身、クラウド環境が当たり前になっている部分もありますが、やはり安定的にマシンを稼働し続けるという点で、オンプレではなくクラウドという選択になりました。

サービスの使用感は?

一番の成果は応答スピード

また、コストパフォーマンスにも優れています

導入の経緯の部分でもお話ししましたが、一番の成果はスピードです。

対話サービスにおいては、いかにリアルタイムに応答できるか、レスポンスタイムが早いか、が勝負です。要するに人間と人間の会話のリターンスピードと、どれだけ遜色なく応答を返せるかということが求められます。

人が発話してから、話の内容を理解し、記憶し、必要な応答分を作り上げてそれを返すという自然の流れが勝負どころになるので、少しでも早く返せることがとても重要なポイントになってきます。

スーパーコンピューターは元来、科学計算などで使用されるように、いかに大量のデータを効率よく計算して、答えを導き出すかということが求められます。ですので、我々の使用方法は使い方としては異端児かもしれません。

AI対話はさまざまなモジュールを通過するため、対話エンジンが使える時間はせいぜい400msが限界です。残りの時間を、アバターのためのレンダリングやTTSの音声合成の処理に費やしていきます。そのため、レスポンス重視という点でも「SX-Aurora TSUBASA クラウド」を使わせてもらえたことで、対話エンジンの応答スピードが最大の成果といえます。

あとは、実際に計算はしていませんが、コストパフォーマンスも良いと感じています。

現在、他社サーバーを利用している部分もいろいろとありますが、コミュニケーションも含めてカゴヤさんの対応が非常にありがたいなと感じておりますので、なるべく寄せていきたいなということは考えております。

今後の事業展開

介護・サービス・医療・教育など

多方面へのサービス展開を考えています

今後のサービス展開としては、いくつかありますが大きく考えているところでは以下の通りです。

まずは現在のメインとなっている介護分野に関して。介護する側の精神状態の把握とメンタルケア、また、一人暮らしの方も含めた介護される側の日常会話の活性化 (好きな会話を楽しめる状態の展開)に対して、上記の双方向からのアプローチでの展開を考えております。

二ーズとしては様々なコンシェルジュとしてのものの割合が大きく、デジタルサイネージなどを使った展開も一つのポイントです。ホテルや観光でも、コロナが収束すればいろいろと動き出すと思います。

また、医療分野では、東京大学が作っているスマホ端末で健康状態を自分で管理できるプロダクトへのアバターの搭載や、自動問診の機能強化なども考えております。

面白い分野では教育分野への展開です。例えば、オンライン授業で、事前に先生の授業を学習したアバターが生徒と1対1で対話しながら授業を進行することで、其々の生徒の進度や質問に応じた対応が実現できます。また、例えば歴史上の人物の知識を学習させたアバターを作ると(人格を作り上げると)、仮想的に歴史上の人物との会話が実現します。

こういったことを考えると教育という観点からは様々な使い道が考えられ、今後に大きな可能性を感じています。

事業紹介

AI対話エンジン「LIFE TALK ENGINE」とは

「LIFE TALK ENGINE」は、人の会話を統語論的に解釈し、業務的な会話を行ったり (業務会話※1)、共感・興味を示すための (自由会話※1) 対話応答システムです。

「LIFE TALK ENGINE」は、一般的に検索エンジン等で利用されているAIチャットbotや音声認識システム (教師データから会話のルールを学習し、発話者の言葉の関係性から関連する応答を返すシステム) とは異なり、人の発話の中から見つけ出される要素を文法的に解釈して、次のアクションにつなげる、つまり統語論を基本としたメカニズムになっています。

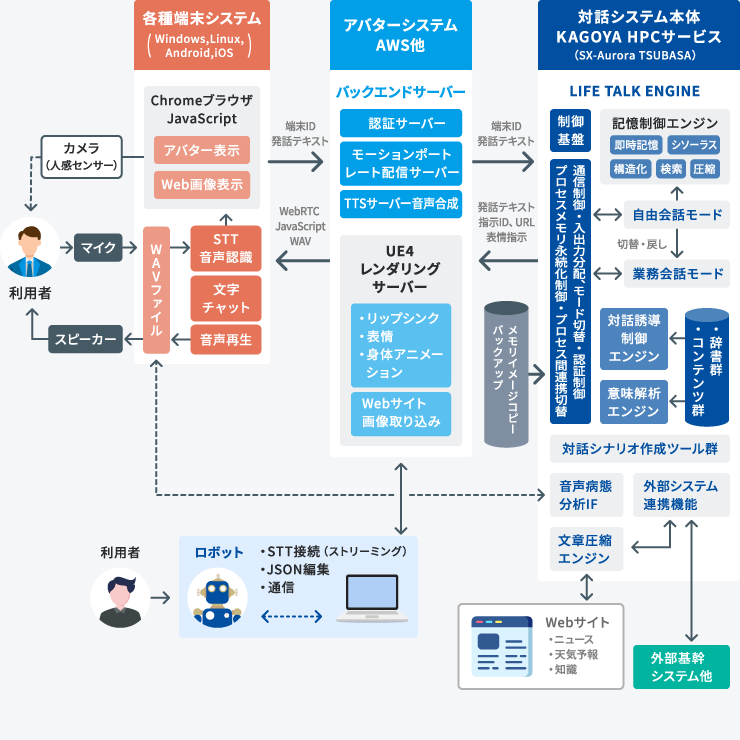

対話エンジン「LIFE TALK ENGINE」のシステムは、様々な機能で成り立っています。

発話内容を構造体分解した状態で記憶する「記憶制御エンジン(※主に自由会話で利用)」、目的に沿った対話を誘導する「対話誘導制御エンジン (※業務会話で利用)」、「意味解析エンジン」、そして、約550種の辞書・コンテンツ群 (約550種の辞書)、対話能力の定義体を引き出すための「対話シナリオ作成ツール」など。そして、全体を統制する制御基板を対話エンジン内に内蔵しています。

サービス構成としては、上記のシステムから会話に必要な言葉を導き出した後、構成図中央のアバターシステムでアバターやロボットを使って外部に表明し、様々な業種・業務に展開しております。

アバターを通じた対話エンジンの使用により人間の能力値を拡張すること。これが、「LIFE TALK ENGINE」の大きな役割だと思っております。